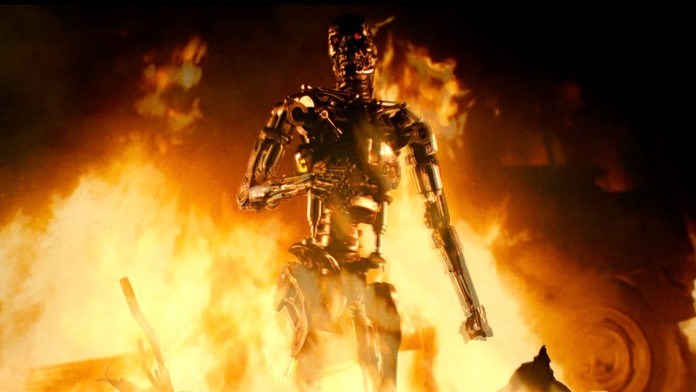

Pentagón sa zahráva s ohňom, AI využíva bez dôkladného testovania. Začína to pripomínať scenár z Terminátora

Americká armáda sa čoraz viac spolieha na umelú inteligenciu pri rozhodovaní na bojisku. Nová analýza však varuje, že Pentagón zavádza tieto systémy rýchlejšie, než ich dokáže dôkladne otestovať.

Spojené štáty chcú umelú inteligenciu vo väčšej miere zapojiť do obrany krajiny. Minister obrany Pete Hegseth je hlasný zástanca integrácie AI do vojenských operácií. Pentagón sa pre tento zámer dostal do otvoreného sporu s firmou Anthropic, ktorá stojí za známou umelou inteligenciou Claude.

Korene tohto ostrého konfliktu siahajú k zásadnému etickému sporu o mieru kontroly nad umelou inteligenciou na bojisku. Generálny riaditeľ Anthropicu Dario Amodei totiž odmietol požiadavky Pentagónu na odstránenie bezpečnostných poistiek, ktoré bránia zneužitiu ich modelov na riadenie plne autonómnych zbraní. Obáva sa, že vláda povolí umelej inteligencii zabíjať bez priameho dohľadu človeka.

Anthropic sa profiluje ako firma, pre ktorú je bezpečnosť prioritou pred rýchlosťou. Ich cieľom je vyvinúť systémy, ktoré budú spoľahlivými partnermi pre ľudstvo, a nie nekontrolovateľnými nástrojmi moci.

„Znenie zmluvy, ktoré sme dostali od ministerstva obrany, prakticky nepokročilo v tom, aby sa zabránilo využitiu Clauda na hromadné sledovanie Američanov alebo v plne autonómnych zbraniach,“ upozornila firma podľa portálu Axios. „S čistým svedomím nemôžeme ich požiadavkám vyhovieť,“ dodávajú predstavitelia spoločnosti.

Prečítajte si tiež:

Firma sa ocitla na čiernej listine

Biely dom urobil nevídaný krok a označil Anthropic za bezpečnostné riziko. Spor o kontrolu nad autonómnymi zbraňami a sledovaním občanov vyústil do vyradenia chatbota Claude z vládnych zákaziek.

Do sporu navyše dramaticky vstúpila konkurenčná spoločnosť OpenAI, ktorá využila oslabenie svojho rivala a uzavrela s Pentagónom dohodu o nahradení Anthropicu v klasifikovaných vojenských prostrediach.

Napätie vyvrcholilo v kritickom čase, len krátko pred vypuknutím vojny v Iráne, kedy sa otázka efektívneho nasadenia AI stala pre administratívu prioritou národnej bezpečnosti. Zatiaľ čo Anthropic argumentuje, že ich bezpečnostné výnimky sa týkajú len vysokej úrovne rozhodovania a nie bežných operácií, Pentagón vníma ich postoj ako priame ohrozenie bojaschopnosti.

Podľa interného memoranda, ktoré získala stanica CBS News, ministerstvo obrany oficiálne informovalo vysokých veliteľov v rámci celých amerických ozbrojených síl, že musia do 180 dní odstrániť zo svojich systémov produkty umelej inteligencie spoločnosti Anthropic.

Prečítajte si tiež:

Bola za útokom na iránsku školu AI?

Podľa denníka Wall Street Journal mali Američania využiť umelú inteligenciu Claude napríklad pri plánovaní misie vo Venezuele, počas ktorej zadržali jej prezidenta Nicolása Madura.

Zároveň pribúdajú informácie, podľa ktorých mohla AI Claude zohrať kľúčovú, ale zároveň aj tragickú úlohu pri tragédii v iránskej škole, kde po zásahu americkej rakety zomrelo 175 ľudí.

Podľa denníka The Wall Street Journal bola Claude AI od spoločnosti Anthropic „zabudovaná“ do operácie v Iráne od začiatku, pomáhala s hodnotením spravodajských informácií, identifikáciou cieľov a simuláciami bojov.

Napriek spomenutému zákazu zostala Claude v prevádzke vďaka partnerstvám ako Maven Smart System od Palantiru, ktorý spracoval viac ako 1 000 cieľov za prvých 24 hodín.

Prečítajte si tiež:

Algoritmy nie sú neomylné

Pentagón v posledných rokoch výrazne zrýchlil spoluprácu s technologickými firmami. Americká armáda sa čoraz viac spolieha na umelú inteligenciu pri rozhodovaní na bojisku. Moderné vojny totiž produkujú obrovské množstvo dát, ktoré ľudia nedokážu spracovať dostatočne rýchlo.

Umelá inteligencia sa nepoužíva len pri bojových operáciách. Pentagón ju nasadzuje aj v logistike, plánovaní zásobovania alebo pri predpovedaní porúch vojenskej techniky.

Nová analýza však varuje, že americká armáda zavádza tieto systémy rýchlejšie, než ich dokáže dôkladne otestovať.

Autori analýzy upozorňujú, že technologický optimizmus môže skrývať vážne riziká. Algoritmy totiž nie sú neomylné. Ak AI nesprávne vyhodnotí situáciu, môže označiť civilistu ako legitímny vojenský cieľ alebo naopak prehliadnuť skutočnú hrozbu.

„Chyby umelej inteligencie sa môžu reťaziť a viesť k zlyhaniu celého systému, ktorý nesprávne identifikuje civilistov ako ciele a zároveň prehliadne skutočné hrozby,“ upozorňujú autori analýzy.

Takéto zlyhania môžu mať vážne následky. Nesprávne rozhodnutie môže ohroziť civilistov, vojakov aj samotnú operáciu.

Prečítajte si tiež:

AI v konfliktoch preferuje jadrový útok

Využitie umelej inteligencie na vojenské účely môže mať veľmi závažné dôsledky, ako ukazuje nedávny pokus na King's College London. V ňom dostali modely ChatGPT, Claude a Gemini za úlohu vyriešiť vážne medzinárodné spory, pričom sa počítalo aj s ozbrojenými konfliktmi. Výsledok však podľa webu New Scientist odborníkov prekvapil.

V 95 % prípadov sa totiž umelá inteligencia rozhodla pre použitie jadrových zbraní. „Jadrové tabu sa pre stroje nezdá byť také silné ako pre ľudí,“ upozorňuje vedúci výskumu Kenneth Payne. „Z hľadiska jadrového rizika sú tieto zistenia znepokojujúce,“ dodáva James Johnson z Univerzity v Aberdeene.

Odborníci zatiaľ nepredpokladajú, že by umelá inteligencia získala priamy prístup k jadrovým zbraniam. Za potenciálne nebezpečnú však považujú situáciu, keď si vysokí predstavitelia pod časovým tlakom a v strese nechajú od umelej inteligencie poradiť v podobných veciach.

Prečítajte si tiež:

Čína varuje USA pred scenárom z Terminátora

Čína minulý týždeň v stredu varovala Spojené štáty, že nadmerné využívanie umelej inteligencie v armáde by mohlo svet uvrhnúť do dystopickej budúcnosti podobnej filmu „Terminátor“.

„Takéto rozhodnutia, ako je neobmedzené využívanie umelej inteligencie armádou, využívanie umelej inteligencie ako nástroja na porušovanie suverenity iných národov, umožňovanie umelej inteligencii nadmerne ovplyvňovať rozhodnutia v boji a udeľovanie právomoci algoritmom rozhodovať o živote a smrti, nielenže narúšajú etické obmedzenia a zodpovednosť vo vojnách, ale tiež predstavujú riziko, že táto technológia sa vymkne spod kontroly,“ povedal v stredu hovorca čínskeho ministerstva obrany Ťiang Pin.

Film Terminátor, ktorý bol uvedený do kín v roku 1984, zobrazuje apokalyptickú budúcnosť v ktorej vládu prevzali stroje.

Všetko sa začalo, keď americká vláda vytvorila systém Skynet na princípe novej umelej inteligencie, aby mohol brániť vládne a vojenské počítače. Po spustení získal Skynet kontrolu nad všetkými počítačmi pripojenými k sieti. Vyhodnotil ľudí ako hrozbu a pokúsil sa ich odstrániť pomocou jadrových zbraní.

„Katastrofická budúcnosť zobrazená v americkom filme Terminátor sa jedného dňa môže stať skutočnosťou,“ varoval hovorca čínskeho ministerstva obrany.

Nastaviť hranice umelej inteligencii sa snažia politici na celom svete. Téme sme sa venovali v archívnej reportáži v priloženom videu:

Práve sa číta

Sledujte Televízne noviny vo full HD a bez reklám na Voyo